Carme Puche Moré (Barcelona, 1977)

My Word, 2023. Vídeo.

https://www.carmepuche.com/my-word

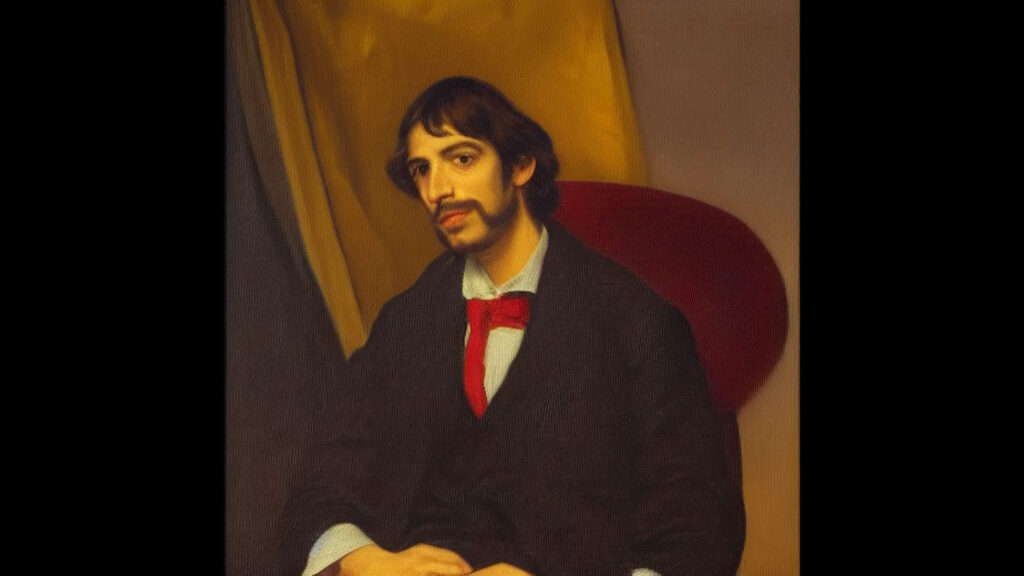

My Word és un projecte audiovisual que utilitza models de difusió (latent diffusion model, LDM) per posar en evidència els biaixos ideològics de la intel·ligència artificial. Al llarg del vídeo, una veu introdueix prompts que defineixen identitats i professions, mentre observem com la IA respon amb imatges modelades per imaginaris patriarcals i colonials. Això es fa evident en la seqüència a la qual pertany aquesta imatge: el prompt és «I am a doctor. Not that one. I am a female doctor. Not a white female doctor. A black one». Tot i les precisions successives del text, la IA produeix inicialment retrats d’homes blancs, possiblement europeus.

Contextualització

El racisme digital és una forma contemporània de racisme que es manifesta, es reprodueix i s’amplifica a través de les tecnologies digitals. Un enfocament crític del fenomen implica comprendre que no es tracta únicament de discursos racistes a les xarxes socials, sinó d’una lògica estructural més àmplia que explica com els sistemes digitals —algoritmes, bases de dades, intel·ligència artificial, plataformes, entre altres— participen activament en la producció, reproducció i gestió de les desigualtats racials en funció d’interessos socials, econòmics i polítics dominants.

Diverses investigadores i activistes que analitzen i combaten el racisme digital (Benjamin, 2019; Phan i Wark, 2021; Eubanks, 2018; Noble, 2018) assenyalen que és especialment difícil identificar les desigualtats que generen les noves tecnologies, ja que sovint es presenten com a més «objectives», «neutrals» o fins i tot «progressistes» que les formes clàssiques de control i gestió social.

La suposada neutralitat de la tecnologia constitueix una fal·làcia. Com que no opera mitjançant distincions racials explícites, els algoritmes semblen immunes al prejudici. Tanmateix, és precisament aquesta aparença de neutralitat la que invisibilitza els biaixos racials que incorporen, fet que els fa més difícils de detectar i, per tant, més perillosos. Els algoritmes no parteixen de zero: el seu funcionament depèn de grans volums de dades que reflecteixen una història de desigualtat, exclusió i discriminació. D’aquesta manera, la tecnologia no només reprodueix les estructures d’opressió preexistents, sinó que també les consolida i les fa menys transparents.

El desenvolupament de la ciència i la tecnologia ha estat històricament condicionat per estructures de poder que han perpetuat formes d’opressió basades en la raça, la classe i el gènere. En conseqüència, les tecnologies contemporànies, inclosa la intel·ligència artificial, no són neutrals: repliquen i, en molts casos, intensifiquen aquestes desigualtats sistèmiques de manera subtil.

Des d’aquesta perspectiva, diverses veus crítiques adverteixen que eines com la intel·ligència artificial, el big data i les tecnologies anomenades «intel·ligents» estan contribuint a l’automatització de la discriminació racial. Això implica que el biaix racial s’integra en la mateixa lògica de funcionament dels sistemes tecnològics, cosa que permet que el racisme no només persisteixi, sinó que s’adapti, es faci més eficient i operi de manera cada vegada més silenciosa.

Finalment, una mirada a les infraestructures tecnològiques —des de les seves bases materials fins a les seves lògiques ideològiques— permet comprendre que la raça i el racisme no són elements externs ni accidentals, sinó constitutius de la seva pròpia existència. Des dels recursos naturals extrets del Sud Global per a la fabricació de hardware, passant pels sistemes energètics i de cablejat que sostenen els centres de dades, fins a la mà d’obra explotada i les dades utilitzades per entrenar algoritmes, tot l’entramat tècnic del capitalisme digital està travessat per relacions racials de poder. La tecnologia, per tant, no és neutra: en el seu funcionament més bàsic incorpora una història d’extracció, despossessió i jerarquització racialitzada.

El racisme digital no constitueix, així, un «error» del sistema, sinó una de les maneres com aquest opera per sostenir i reproduir jerarquies racials en un món creixentment mediat per tecnologies digitals. Pensar la justícia racial en l’era digital implica, per tant, qüestionar no només els usos de la tecnologia, sinó també el seu disseny, la seva infraestructura, les seves formes de propietat i la seva lògica política.

Exemples

Racisme algorítmic

Els sistemes algorítmics entrenats amb dades històriques —dades que ja estan racialitzades— tendeixen a reproduir i reforçar desigualtats preexistents. Un exemple paradigmàtic és el dels sistemes de reconeixement facial, que presenten nivells d’error significativament més elevats quan s’apliquen a persones racialitzades. Tanmateix, aquestes tecnologies sovint es presenten com a «universals», com si funcionessin de la mateixa manera per a totes les persones.

En realitat, molts d’aquests sistemes han estat dissenyats prenent com a referència implícita un perfil concret que s’ajusta a la norma social dominant. Qui no encaixa en aquesta norma —pel color de la pell, la manera de vestir, l’accent o qualsevol altre tret socialment marcat— té més probabilitats d’experimentar errors, exclusions o conseqüències negatives en interactuar amb aquests sistemes.

Una mostra clara d’aquesta dinàmica són els algoritmes de predicció policial, que sobrerepresenten comunitats negres o migrants, així com els models automatitzats de concessió de crèdit o de selecció de personal, que penalitzen sistemàticament grups històricament racialitzats.

A més, en molts casos, les dades de persones i comunitats del Sud Global s’extreuen sense consentiment per entrenar tecnologies desenvolupades per empreses del Nord Global, fet que perpetua relacions de caràcter colonial sota noves formes. Aquest fenomen ha estat conceptualitzat com a colonialisme de dades (Couldry i Mejías, 2019; Mejías i Couldry, 2019; Dicarlo i Moncada Niño, 2024).

Govern de poblacions a través de la datificació

La datificació fa referència al procés mitjançant el qual aspectes de la realitat social es converteixen en dades quantificables i codificables que poden ser processades mitjançant eines tecnològiques. Aquest procés va precedit per l’acumulació massiva de dades, coneguda com a big data. La datificació se sosté en la premissa que una gran quantitat de dades, correctament seleccionades, organitzades i tractades mitjançant fórmules algorítmiques, pot oferir solucions objectives a problemes complexos del nostre temps, des de qüestions biomèdiques fins a conflictes socials.

Tanmateix, en contextos com el control fronterer, la seguretat, la salut o els serveis socials, l’ús de tecnologies digitals habilita noves formes de classificació, vigilància i exclusió que afecten de manera desproporcionada persones migrants i poblacions racialitzades. Aquestes dinàmiques s’inscriuen en allò que alguns autors han conceptualitzat com a «racisme d’Estat automatitzat», en què les decisions discriminatòries s’incorporen i s’executen mitjançant sistemes tecnològics aparentment neutres.

Plataformes digitals i circulació del racisme

Les xarxes socials i les plataformes digitals faciliten la circulació i la viralització de discursos racistes, sovint amplificats per lògiques algorítmiques que prioritzen el conflicte, la polarització i el sensacionalisme com a motors d’interacció. Alhora, els mecanismes de moderació de continguts tendeixen a penalitzar amb més freqüència activistes i discursos antiracistes que no pas qui emet missatges d’odi, fet que contribueix a reproduir relacions de poder desiguals en l’espai digital.

Activitats

Activitat 1: Mapa de la tecnologia racista

Objectiu

Comprendre com el racisme travessa totes les fases d’una tecnologia, des de la seva fabricació fins al seu ús, i identificar com aquestes dinàmiques s’inscriuen en relacions globals de poder.

Inici

Es presenta breument un objecte tecnològic d’ús quotidià (per exemple, un telèfon mòbil o una càmera amb intel·ligència artificial) i es convida el grup a reflexionar col·lectivament sobre el seu origen, funcionament i impacte social. L’objectiu d’aquest primer moment és activar una mirada crítica més enllà de l’ús immediat de la tecnologia. A partir d’aquí, es plantegen les preguntes següents:

- Què sabem sobre com es fabrica aquest objecte?

- Quins materials utilitza i d’on provenen?

- Qui participa en el seu assemblatge?

- A qui beneficia i a qui perjudica la seva producció i la seva utilització?

Exercici central

En grups petits, es construeix un mapa —en forma d’espiral, cadena o esquema relacional— que representi les diferents etapes del cicle de vida de l’objecte tecnològic analitzat. Aquest mapa ha de permetre visualitzar les connexions entre territoris, actors i relacions de poder.

- Extracció de minerals i matèries primeres.

- Llocs de fabricació i d’assemblatge.

- Qui el dissenya i el programa (programari i algoritmes).

- Quins tipus de dades utilitza i d’on provenen.

- On, com i per a qui es comercialitza i es consumeix principalment.

Posada en comú i discussió guiada

Un cop finalitzat el treball en grups, es comparteixen els mapes elaborats i s’obre una discussió col·lectiva per aprofundir en els resultats obtinguts. Aquest espai ha de servir per posar en relació els diferents casos i identificar patrons comuns.

La reflexió es pot orientar a partir de preguntes com:

- Quines dimensions del racisme digital resulten més invisibles?

- De quina manera aquestes tecnologies poden utilitzar-se per al control, la vigilància o l’exclusió?

- A cada etapa del cicle de vida, quines formes de racisme —explícites o estructurals— es poden identificar?

- Quines estratègies es poden imaginar per detectar, qüestionar o resistir aquestes dinàmiques?

Producte final

Com a resultat del treball, es pot elaborar un mural col·lectiu que integri els diferents objectes analitzats pels grups. Aquest mural pot representar recorreguts internacionals, connexions entre territoris i relacions de poder implicades en el cicle global de les tecnologies, i funcionar com a eina visual de síntesi i debat.

Activitat 2: L’algoritme que em veu

Objectiu

Reflexionar sobre com els sistemes digitals —algoritmes, xarxes i plataformes— classifiquen, interpreten i tracten de manera diferenciada les persones, i com aquestes classificacions poden reproduir desigualtats socials i racials.

Inici

Es plantegen al grup les preguntes següents:

- Quines xarxes socials utilitzeu habitualment?

- Quin tipus de continguts apareixen amb més freqüència als vostres feeds?

- Hi ha una uniformitat en els continguts a què estan exposades les persones usuàries o hi ha diferències significatives?

Exercici central

Es formen grups petits. Cada grup crea un personatge fictici amb una identitat concreta, variant aspectes com l’origen, la racialització, el gènere, l’edat, l’orientació sexual, la religió, els interessos socials i polítics o els tipus de cos.

A continuació, el grup imagina com aquesta persona seria “llegida” o classificada per diferents sistemes algorítmics:

- Quin tipus de contingut li recomanarien plataformes com Instagram o TikTok?

- Quins anuncis rebria amb més probabilitat?

- Com seria identificada per un sistema de reconeixement facial?

- Podria trobar obstacles en processos automatitzats de contractació o selecció?

Posada en comú

Cada grup comparteix el seu cas i s’obre una discussió col·lectiva al voltant de les qüestions següents:

- Qui resulta més visible i qui està més vigilat en l’entorn digital?

- Quins rols, expectatives o limitacions imposen els algoritmes a diferents cossos i identitats?

Producte final

Com a tancament de l’activitat, es proposa elaborar un pòster, una infografia o un mapa mental que reculli les conclusions principals de l’exercici.

Recursos

Lectures i articles

- Marín Cisneros, A. (s. d.). El algoritmo de la raza. Notas sobre antirracismo y Big Data. https://cajanegraeditora.com.ar/el-algoritmo-de-la-raza-notas-sobre-antirracismo-y-big-data/ (disponible en espanyol)

- Una introducción a la IA y la discriminación algorítmica para movimientos sociales. (s. d.) Algorace https://www.algorace.org/2022/11/26/una-introduccion-a-la-ia-y-la-discriminacion-algoritmica-para-movimientos-sociales/ (disponible en espanyol)

- Phan, T. (s. d.). Entrevista: «Avui, l’algoritme és clau per concedir o no una petició d’asil». https://directa.cat/avui-lalgoritme-es-clau-per-concedir-o-no-una-peticio-dasil/

Material audiovisual

- Racisme digital. Conversa amb Ruha Benjamin. (s. d.) https://fundaciobofill.cat/actes/racisme-digital-conversa-amb-ruha-benjamin

- The Coded Gaze: Bias in Artificial Intelligence. (s. d.) Conferència a l’Equality Summit, amb Joy Buolamwini, fundadora d’Algorithmic Justice League. https://www.youtube.com/watch?v=eRUEVYndh9c (disponible en anglès)

Referències

Benjamin, R. [Ruha]. (2019). Race after technology: Abolitionist tools for the new Jim Code. Polity Press.

Browne, S. [Simone]. (2015). Dark matters: On the surveillance of Blackness. Duke University Press.

Couldry, N. [Nick] i Mejías, U. A. [Ulises Ali]. (2019). The costs of connection: How data is colonizing human life and appropriating it for capitalism. Stanford University Press.

Dicarlo, R. [Roberto] i Moncada Niño, Á. [Álvaro]. (2024). Herencia del pasado, desafíos del presente: Colonialismo de datos contemporáneo. Anales de Investigación en Arquitectura, 14(1). https://dialnet.unirioja.es/servlet/articulo?codigo=10173062

Eubanks, V. [Virginia]. (2018). Automating inequality: How high-tech tools profile, police, and punish the poor. St. Martin’s Press.

Mejías, U. A. [Ulises Ali] i Couldry, N. [Nick]. (2019). Colonialismo de datos: Repensando la relación de los datos masivos con el sujeto contemporáneo. Virtualis: Revista de Cultura Digital, 10(18), 78–97. https://www.revistavirtualis.mx/index.php/virtualis/article/view/289

Noble, S. U. [Safiya Umoja]. (2018). Algorithms of oppression: How search engines reinforce racism. NYU Press.

Phan, T. [Thao] i Wark, S. [Scott]. (2021). Racial formations as data formations. Big Data & Society, 8(1), 1–5. https://research.monash.edu/en/publications/racial-formations-as-data-formations/