Carme Puche Moré (Barcelona, 1977)

My Word, 2023. Video.

https://www.carmepuche.com/my-word

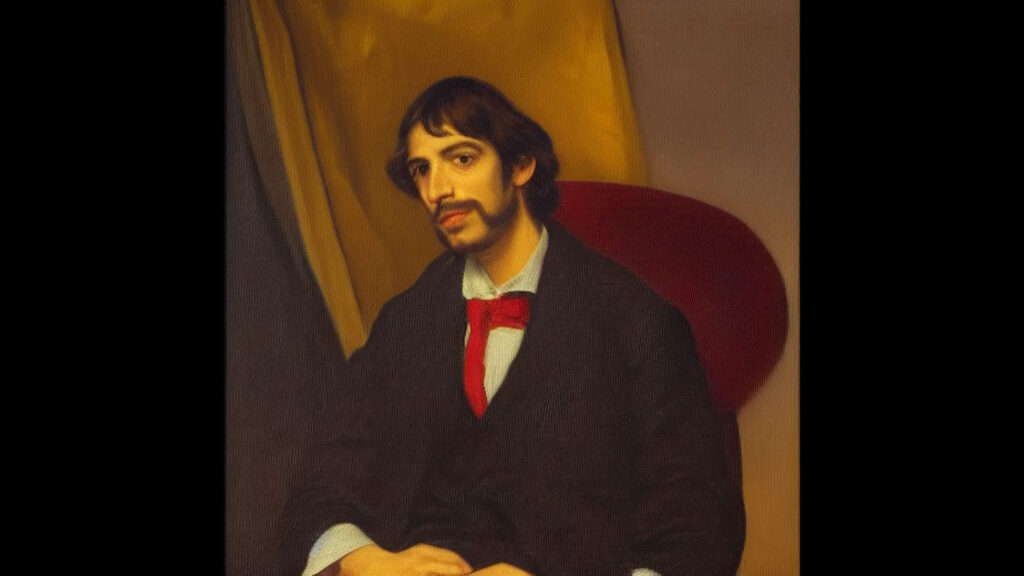

My Word es un proyecto audiovisual que utiliza modelos de difusión (latent diffusion model, LDM) para poner en evidencia los sesgos ideológicos de la inteligencia artificial. A lo largo del vídeo, una voz introduce prompts que definen identidades y profesiones, mientras observamos cómo la IA responde con imágenes modeladas por imaginarios patriarcales y coloniales. Así ocurre en la secuencia a la que pertenece esta imagen: el prompt es «I am a doctor. Not that one. I am a female doctor. Not a white female doctor. A black one». Aunque el texto incorpora precisiones sucesivas, la IA produce en primer término retratos de hombres blancos, posiblemente europeos.

Contextualización

El racismo digital es una forma contemporánea de racismo que se manifiesta, se reproduce y se amplifica a través de las tecnologías digitales. Un enfoque crítico del fenómeno implica comprender que no se trata únicamente de discursos racistas en redes sociales, sino de una lógica estructural más amplia que explica cómo los sistemas digitales —algoritmos, bases de datos, inteligencia artificial, plataformas, entre otros— participan activamente en la producción, reproducción y gestión de las desigualdades raciales en función de intereses sociales, económicos y políticos dominantes.

Diversas investigadoras y activistas que analizan y combaten el racismo digital (Benjamin, 2019; Phan y Wark, 2021; Eubanks, 2018; Noble, 2018) señalan que resulta especialmente difícil identificar las desigualdades que generan las nuevas tecnologías, ya que estas suelen presentarse como más «objetivas», «neutrales» o incluso «progresistas» que las formas clásicas de control y gestión social.

La supuesta neutralidad de la tecnología constituye una falacia. Al no operar mediante distinciones raciales explícitas, los algoritmos parecen inmunes al prejuicio. Sin embargo, es precisamente esta apariencia de neutralidad la que invisibiliza los sesgos raciales que incorporan, haciéndolos más difíciles de detectar y, por tanto, más peligrosos. Los algoritmos no parten de cero: su funcionamiento depende de grandes volúmenes de datos que reflejan una historia de desigualdad, exclusión y discriminación. De este modo, la tecnología no solo reproduce las estructuras de opresión preexistentes, sino que también las consolida y las vuelve menos transparentes.

El desarrollo de la ciencia y la tecnología ha estado históricamente condicionado por estructuras de poder que han perpetuado formas de opresión basadas en la raza, la clase y el género. En consecuencia, las tecnologías contemporáneas, incluida la inteligencia artificial, no son neutrales: replican y, en muchos casos, intensifican estas desigualdades sistémicas de manera sutil.

Desde esta perspectiva, diversas voces críticas advierten que herramientas como la inteligencia artificial, el Big Data y las tecnologías denominadas «inteligentes» están contribuyendo a la automatización de la discriminación racial. Esto implica que el sesgo racial se integra en la propia lógica de funcionamiento de los sistemas tecnológicos, permitiendo que el racismo no solo persista, sino que se adapte, se haga más eficiente y opere de forma cada vez más silenciosa.

Por último, una mirada a las infraestructuras tecnológicas —desde sus bases materiales hasta sus lógicas ideológicas— permite comprender que la raza y el racismo no son elementos externos ni accidentales, sino constitutivos de su propia existencia. Desde los recursos naturales extraídos del Sur Global para la fabricación de hardware, pasando por los sistemas energéticos y de cableado que sostienen los centros de datos, hasta la mano de obra explotada y los datos utilizados para entrenar algoritmos, todo el entramado técnico del capitalismo digital está atravesado por relaciones raciales de poder. La tecnología, por tanto, no es neutra: en su funcionamiento más básico incorpora una historia de extracción, despojo y jerarquización racializada.

El racismo digital no constituye, así, un «fallo» del sistema, sino una de las formas en que este opera para sostener y reproducir jerarquías raciales en un mundo crecientemente mediado por tecnologías digitales. Pensar en justicia racial en la era digital implica, por ello, cuestionar no solo los usos de la tecnología, sino también su diseño, su infraestructura, sus formas de propiedad y su lógica política.

Ejemplos

Racismo algorítmico

Los sistemas algorítmicos entrenados con datos históricos —datos que ya están racializados— tienden a reproducir y reforzar desigualdades preexistentes. Un ejemplo paradigmático es el de los sistemas de reconocimiento facial, que presentan niveles de error significativamente más elevados cuando se aplican a personas racializadas. No obstante, estas tecnologías suelen presentarse como «universales», como si funcionaran de igual manera para todas las personas.

En realidad, muchos de estos sistemas han sido diseñados tomando como referencia implícita un perfil concreto que se ajusta a la norma social dominante. Quienes no encajan en esa norma —por el color de la piel, la forma de vestir, el acento o cualquier otro rasgo socialmente marcado— tienen más probabilidades de experimentar fallos, exclusiones o consecuencias negativas al interactuar con estos sistemas.

Una muestra clara de ello son los algoritmos de predicción policial, que sobrerrepresentan a comunidades negras o migrantes, así como los modelos automatizados de concesión de crédito o de selección de personal, que penalizan sistemáticamente a grupos históricamente racializados.

Además, en muchos casos, los datos de personas y comunidades del Sur Global son extraídos sin consentimiento para entrenar tecnologías desarrolladas por empresas del Norte Global, lo que perpetúa relaciones de carácter colonial bajo nuevas formas. Este fenómeno ha sido conceptualizado como colonialismo de datos (Couldry y Mejías, 2019; Mejías y Couldry, 2019; Dicarlo y Moncada Niño, 2024).

Gobierno de poblaciones a través de la datificación

La datificación se refiere al proceso mediante el cual aspectos de la realidad social se convierten en datos cuantificables y codificables que pueden ser procesados mediante herramientas tecnológicas. A este proceso lo precede la acumulación masiva de datos, conocida como Big Data. La datificación se sostiene en la premisa de que una gran cantidad de datos, correctamente seleccionados, organizados y tratados mediante fórmulas algorítmicas, puede ofrecer soluciones objetivas a problemas complejos de nuestro tiempo, desde cuestiones biomédicas hasta conflictos sociales.

Sin embargo, en contextos como el control fronterizo, la seguridad, la salud o los servicios sociales, el uso de tecnologías digitales habilita nuevas formas de clasificación, vigilancia y exclusión que afectan de manera desproporcionada a personas migrantes y poblaciones racializadas. Estas dinámicas se vinculan con lo que algunos autores han conceptualizado como «racismo de Estado automatizado», en el que las decisiones discriminatorias se incorporan y se ejecutan a través de sistemas tecnológicos aparentemente neutrales.

Plataformas digitales y circulación del racismo

Las redes sociales y las plataformas digitales facilitan la circulación y viralización de discursos racistas, a menudo amplificados por lógicas algorítmicas que priorizan el conflicto, la polarización y el sensacionalismo como motores de interacción. Al mismo tiempo, los mecanismos de moderación de contenidos tienden a penalizar con mayor frecuencia a activistas y discursos antirracistas que a quienes emiten mensajes de odio, reproduciendo así relaciones de poder desiguales en el espacio digital.

Actividades

Actividad 1: Mapa de la tecnología racista

Objetivo

Comprender cómo el racismo atraviesa todas las fases de una tecnología, desde su fabricación hasta su uso.

Inicio

Se presenta brevemente un objeto tecnológico de uso cotidiano (por ejemplo, un teléfono móvil o una cámara con inteligencia artificial) y se plantean las siguientes preguntas al grupo:

- ¿Qué sabemos sobre cómo se fabrica este objeto?

- ¿Qué materiales utiliza y de dónde proceden?

- ¿Quién participa en su ensamblaje?

- ¿A quién beneficia y a quién perjudica su producción y su utilización?

Ejercicio central

En grupos, se construye un mapa en espiral o en forma de cadena que represente las distintas etapas del ciclo de vida del objeto tecnológico analizado. Para cada etapa, se pueden considerar las siguientes cuestiones:

- Extracción de minerales y materias primas.

- Lugares de fabricación y ensamblaje.

- Quién lo diseña y lo programa (software y algoritmos).

- Qué tipos de datos utiliza y de dónde proceden.

- Dónde, cómo y para quién se comercializa y se consume principalmente.

Puesta en común y discusión guiada

A partir del trabajo realizado, se abre una discusión colectiva en torno a las siguientes preguntas:

- ¿Qué dimensiones del racismo digital resultan más invisibles?

- ¿De qué manera estas tecnologías pueden utilizarse para el control, la vigilancia o la exclusión?

- En cada etapa del ciclo de vida, ¿qué formas de racismo —explícitas o estructurales— pueden identificarse?

- ¿Qué estrategias pueden imaginarse para detectar, cuestionar o resistir estas dinámicas?

Producto final

Como resultado del trabajo, se puede elaborar un mural colectivo en el que se crucen los distintos objetos analizados por los grupos. Este mural puede mostrar recorridos internacionales, conexiones entre territorios y relaciones de poder implicadas en el ciclo global de las tecnologías.

Actividad 2: «El algoritmo que me ve»

Objetivo

Reflexionar sobre cómo los sistemas digitales —algoritmos, redes y plataformas— clasifican y tratan de manera diferenciada a las personas.

Inicio

Se plantean al grupo las siguientes preguntas:

- ¿Qué redes sociales utilizáis habitualmente?

- ¿Qué tipo de contenidos aparecen con más frecuencia en vuestros feeds?

- ¿Existe una uniformidad en los contenidos a los que están expuestas las personas usuarias o hay diferencias significativas?

Ejercicio central

Se forman grupos pequeños. Cada grupo crea un personaje ficticio con una identidad concreta, variando aspectos como el origen, la racialización, el género, la edad, la orientación sexual, la religión, los intereses sociales y políticos o los tipos de cuerpo.

A continuación, el grupo imagina cómo esta persona sería “leída” o clasificada por distintos sistemas algorítmicos:

- ¿Qué tipo de contenido le recomendarían plataformas como Instagram o TikTok?

- ¿Qué anuncios recibiría con mayor probabilidad?

- ¿Cómo sería identificada por un sistema de reconocimiento facial?

- ¿Podría encontrar obstáculos en procesos automatizados de contratación o selección?

Puesta en común

Cada grupo comparte su caso y se abre una discusión colectiva en torno a las siguientes cuestiones:

- ¿Quién resulta más visible y quién está más vigilado en el entorno digital?

- ¿Qué roles, expectativas o limitaciones imponen los algoritmos a distintos cuerpos e identidades?

Producto final

Como cierre de la actividad, se propone la elaboración de un póster, una infografía o un mapa mental que recoja las conclusiones principales del ejercicio.

Recursos

Lecturas y artículos

- Marín Cisneros, A. (s. f.). El algoritmo de la raza: Notas sobre antirracismo y Big Data. https://cajanegraeditora.com.ar/el-algoritmo-de-la-raza-notas-sobre-antirracismo-y-big-data/

- Una introducción a la IA y la discriminación algorítmica para movimientos sociales. (2022). Algorace https://www.algorace.org/2022/11/26/una-introduccion-a-la-ia-y-la-discriminacion-algoritmica-para-movimientos-sociales/

- Phan, T. [Thao]. (s. f.). Entrevista: «Avui, l’algoritme és clau per concedir o no una petició d’asil». https://directa.cat/avui-lalgoritme-es-clau-per-concedir-o-no-una-peticio-dasil/ (disponible en catalán)

Material audiovisual

- Racisme Digital: Conversa amb Ruha Benjamin. (s. f.). Fundació Bofill. https://fundaciobofill.cat/actes/racisme-digital-conversa-amb-ruha-benjamin (disponible en catalán)

- The Coded Gaze: Bias in Artificial Intelligence. (s. f.). Conferencia en el Equality Summit, con Joy Buolamwini. https://www.youtube.com/watch?v=eRUEVYndh9c (disponible en inglés)

Referencias

Benjamin, R. [Ruha]. (2019). Race after technology: Abolitionist tools for the new Jim Code. Polity Press.

Browne, S. [Simone]. (2015). Dark matters: On the surveillance of Blackness. Duke University Press.

Couldry, N. [Nick], y Mejías, U. A. [Ulises Ali]. (2019). The costs of connection: How data is colonizing human life and appropriating it for capitalism. Stanford University Press.

Dicarlo, R. [Roberto], y Moncada Niño, Á. [Álvaro]. (2024). Herencia del pasado, desafíos del presente: Colonialismo de datos contemporáneo. Anales de Investigación en Arquitectura, 14(1). https://doi.org/10.18861/ania.2024.14.1

Eubanks, V. [Virginia]. (2018). Automating inequality: How high-tech tools profile, police, and punish the poor. St. Martin’s Press.

Mejías, U. A. [Ulises Ali], y Couldry, N. [Nick]. (2019). Colonialismo de datos: Repensando la relación de los datos masivos con el sujeto contemporáneo. Virtualis: Revista de Cultura Digital, 10(18), 78–97. https://www.revistavirtualis.mx/index.php/virtualis/article/view/289

Noble, S. U. [Safiya Umoja]. (2018). Algorithms of oppression: How search engines reinforce racism. NYU Press.

Phan, T. [Thao], y Wark, S. [Scott]. (2021). Racial formations as data formations. Big Data & Society, 8(1), 1–5. https://research.monash.edu/en/publications/racial-formations-as-data-formations/